Apple wstrzymuje powiadomienia generowane przez AI które są pełne błędów

Apple wstrzymało nową funkcję sztucznej inteligencji (AI), która spotkała się z krytyką i skargami za powtarzające się błędy w streszczeniach nagłówków wiadomości.

Zdjęcie: Getty Images

Gigant technologiczny był pod rosnącą presją, by wycofać tę usługę, która wysyłała powiadomienia wyglądające, jakby pochodziły z aplikacji organizacji medialnych.

„Pracujemy nad ulepszeniami i udostępnimy je w przyszłej aktualizacji oprogramowania”, powiedział rzecznik Apple.

Organizacja dziennikarska Reporterzy Bez Granic (RSF) stwierdziła, że to pokazuje niebezpieczeństwa związane z pośpiesznym wprowadzaniem nowych funkcji.

„Innowacje nigdy nie powinny odbywać się kosztem prawa obywateli do otrzymywania rzetelnych informacji”, napisano w oświadczeniu.

„Ta funkcja nie powinna być ponownie wprowadzana, dopóki nie będzie absolutnie żadnego ryzyka publikowania nieścisłych nagłówków”, dodał Vincent Berthier z RSF.

Fałszywe doniesienia

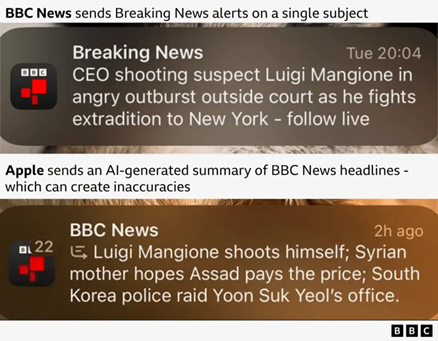

BBC było jedną z grup, które złożyły skargę na tę funkcję, po tym jak alert wygenerowany przez AI Apple'a fałszywie poinformował niektórych czytelników, że Luigi Mangione, mężczyzna oskarżony o zabicie dyrektora generalnego UnitedHealthcare, Briana Thompsona, zastrzelił się.

Według doniesień dziennikarzy i innych użytkowników mediów społecznościowych, funkcja ta również nieprawidłowo streszczała nagłówki z Sky News, New York Times i Washington Post.

„Istnieje ogromna presja [na firmy technologiczne], aby być pierwszymi, które wprowadzą nowe funkcje”, powiedział Jonathan Bright, szef działu AI dla usług publicznych w Alan Turing Institute.

Halucynacje, sytuacje, w których model AI wymyśla informacje, są „prawdziwym problemem”, dodał. „I jak dotąd firmy nie mają sposobu na systematyczne zagwarantowanie, że modele AI nigdy nie będą wymyślać, poza nadzorem ludzkim”.

„Oprócz dezinformowania opinii publicznej, takie halucynacje mogą dodatkowo zaszkodzić zaufaniu do mediów”, powiedział.

Media i organizacje prasowe naciskały na firmę, aby się wycofała, ostrzegając, że funkcja nie jest gotowa, a błędy generowane przez AI pogłębiają problem dezinformacji i spadającego zaufania do wiadomości.

BBC złożyło skargę do Apple w grudniu, ale firma odpowiedziała dopiero w styczniu, obiecując aktualizację oprogramowania, która wyjaśni rolę AI w tworzeniu streszczeń, które były opcjonalne i dostępne tylko dla czytelników z najnowszymi iPhone'ami.

To wywołało kolejną falę krytyki, że gigant technologiczny nie posuwa się wystarczająco daleko.

Alert z wiadomości z grudnia 2024 roku był jednym ze skarg złożonych przez BBC do Apple. Zdjęcie: pochodzące z mediów społecznościowych

Tekst z obrazka:

1. BBC News wysyła powiadomienia z wiadomościami na żywo na jeden temat

Wiadomości na żywo

Podejrzany o postrzelenie CEO, Luigi Mangione, wybucha gniewem przed sądem, walcząc przeciw ekstradycji do Nowego Jorku – śledź na żywo

2. Apple wysyła podsumowanie nagłówków BBC News wygenerowane przez AI – które może zawierać nieścisłości

BBC News

Luigi Mangione postrzelił się; syryjska matka ma nadzieję, że Assad poniesie cenę; policja w Korei Południowej przeszukuje biuro Yoon Suk Yeola.

Apple zdecydowało się teraz całkowicie wyłączyć tę funkcję dla aplikacji z wiadomościami i rozrywką.

„W najnowszych wersjach beta oprogramowania iOS 18.3, iPadOS 18.3 i macOS Sequoia 15.3, podsumowania powiadomień dla kategorii Wiadomości i Rozrywka będą tymczasowo niedostępne”, powiedział rzecznik Apple.

Firma poinformowała, że w przypadku innych aplikacji podsumowania powiadomień generowane przez AI będą pojawiać się kursywą.

„Cieszymy się, że Apple wysłuchało naszych obaw i wstrzymuje funkcję podsumowań dla wiadomości”, powiedział rzecznik BBC.

„Z niecierpliwością czekamy na konstruktywną współpracę w kolejnych etapach. Naszym priorytetem jest dokładność informacji, które dostarczamy odbiorcom, co jest kluczowe dla budowania i utrzymywania zaufania.”

Analiza: Rzadki zwrot akcji ze strony Apple

Autor oryginału: Zoe Kleinman

Apple zazwyczaj twardo stoi przy swoich produktach i rzadko reaguje na krytykę.

To proste oświadczenie giganta technologicznego mówi wiele o tym, jak szkodliwe były błędy popełnione przez jego nową, szeroko promowaną funkcję AI.

Nie tylko przypadkowo rozpowszechniała dezinformację, generując nieścisłe streszczenia wiadomości, ale także szkodziła reputacji organizacji medialnych, takich jak BBC, które opierają swoją wiarygodność na zaufaniu, wyświetlając fałszywe nagłówki obok ich logo.

To niezbyt korzystne dla nowo uruchomionej usługi.

Deweloperzy AI od zawsze podkreślają, że technologia ma tendencję do „halucynacji” (wymyślania rzeczy), a wszystkie chatboty AI zawierają zastrzeżenia, że informacje, które dostarczają, powinny być podwójnie sprawdzane.

Jednak coraz częściej treści generowane przez AI są wyróżniane, w tym w formie podsumowań na szczycie wyszukiwarek, co samo w sobie sugeruje, że są one wiarygodne.

Nawet Apple, z całym swoim finansowym i eksperckim potencjałem, który może przeznaczyć na rozwój tej technologii, publicznie udowodniło, że to jeszcze nie jest ten etap.

Ciekawostką jest również to, że najnowszy błąd, który poprzedził zmianę planów Apple, dotyczył streszczenia AI z treści Washington Post, jak donosi ich technologiczny felietonista Geoffrey A. Fowler.

Warto dodać, że ten serwis informacyjny należy do osoby, którą szef Apple, Tim Cook, dobrze zna - Jeffa Bezosa, założyciela Amazona.

Dział: Technologia

Autor:

Natalie Sherman, Imran Rahman-Jones | Tłumaczenie Julia Nawrocka — praktykantka fundacji: https://fundacjaglosmlodych.org/praktyki/